Мы научились транскрибировать аудиофайлы, для дальнейшего анализа полученной информации, так как развитием технологий и ростом объёмов аудиоконтента задача автоматической транскрипции речи приобрела особую значимость. Транскрибация и перевод устной речи в текстовый формат находят широкое применение в различных сферах, таких как автоматизация звонков в колл-центрах, создание субтитров, улучшение доступности контента и даже в исследованиях искусственного интеллекта.

Современные модели для транскрибации речи, основанные на архитектуре трансформеров, используют подходы многозадачного обучения (Multitask Learning), что позволяет эффективно решать разнообразные задачи — от моноязычной транскрипции и мультиязычного перевода до идентификации присутствия речи в аудиозаписях.

Технологии распознавания речи (ASR) становятся неотъемлемой частью современных приложений — от создания субтитров для видео до аналитики звонков в колл-центрах. На рынке сегодня существуют несколько ведущих решений в этой области, включая Whisper от OpenAI, Google Speech-to-Text, Microsoft Azure Speech и Amazon Transcribe. В статье мы рассмотрим их возможности, уделив особое внимание моделям OpenAI Whisper-1, Whisper Small, Local Whisper Turbo и Yandex SpeechKit.

В статье вы узнаете, как эти инструменты справляются с задачами мультиязычной транскрипции, перевода и анализа речи, и чем они отличаются друг от друга, а так же предоставим готовый код их реализации.1. Общие характеристики технологий

Whisper — это универсальная модель распознавания речи от OpenAI, обученная на большом наборе данных с разнообразным аудиоконтентом. Она является многозадачной моделью, которая может выполнять многоязычное распознавание речи, перевод речи и определение языка. Whisper использует архитектуру трансформеров и лог-Мел спектрограммы для обработки аудиоданных, что делает её одной из самых точных и эффективных моделей в своей категории.

Yandex SpeechKit API — это облачное решение от компании Яндекс, которое предоставляет высококачественные инструменты для обработки речи. SpeechKit включает в себя технологии распознавания речи (speech-to-text), синтеза речи (text-to-speech), а также функции для обработки аудио с помощью машинного обучения и нейросетевых алгоритмов. SpeechKit идеально подходит для создания приложений, требующих интеграции распознавания речи, голосовых команд или преобразования текста в речь.2. Сравнение моделей для распознавания речи

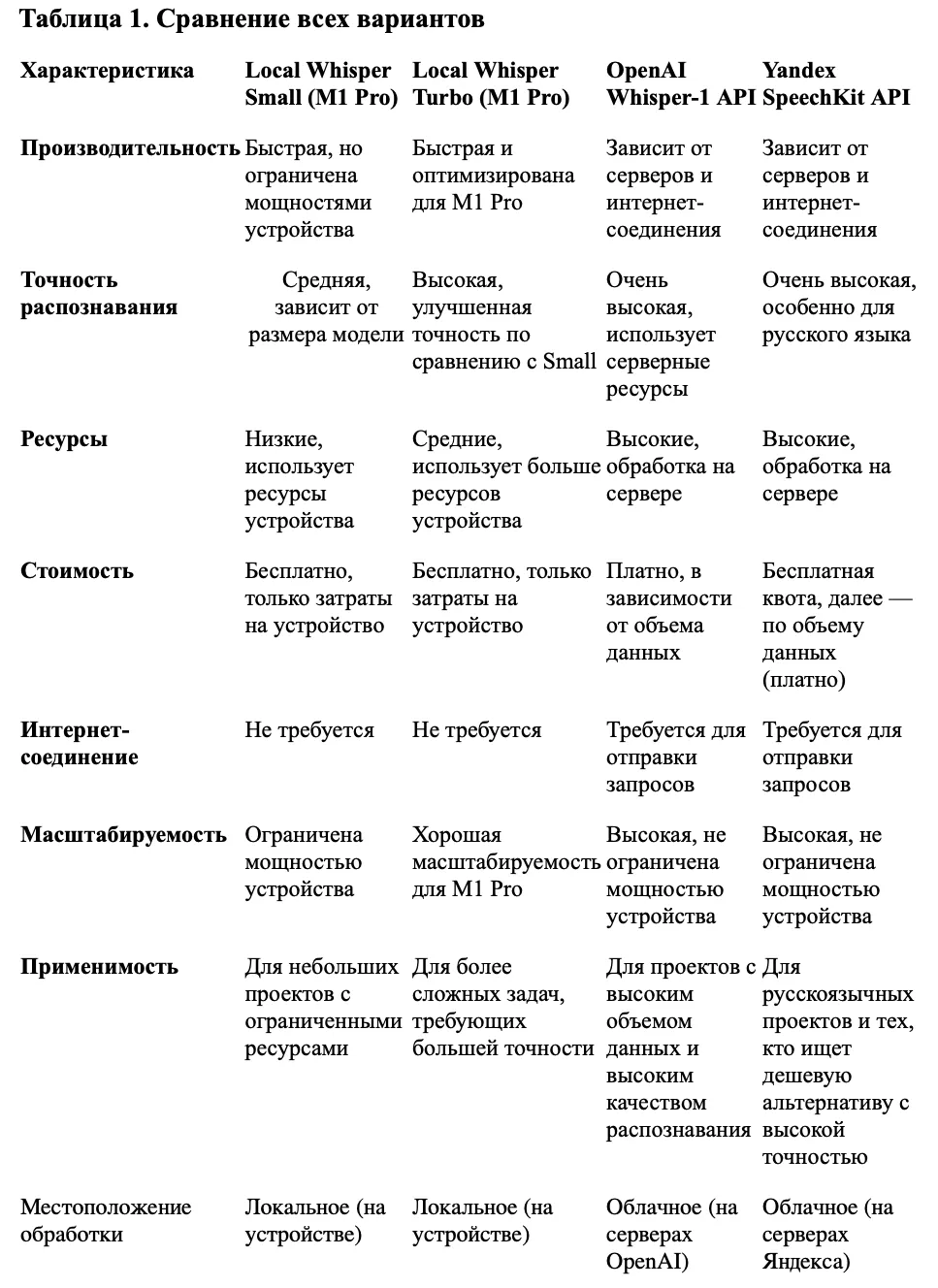

В данном разделе мы более подробно рассмотрим различия между различными вариантами модели Whisper (Local Whisper Small, Whisper Turbo и OpenAI Whisper-1 API) и Yandex SpeechKit с точки зрения ключевых факторов: производительности, точности, ресурсов, стоимости, масштабируемости и необходимости подключения к интернету. Все данные можете рассмотреть по рисунку в

Таблица 1. Сравнение всех вариантов

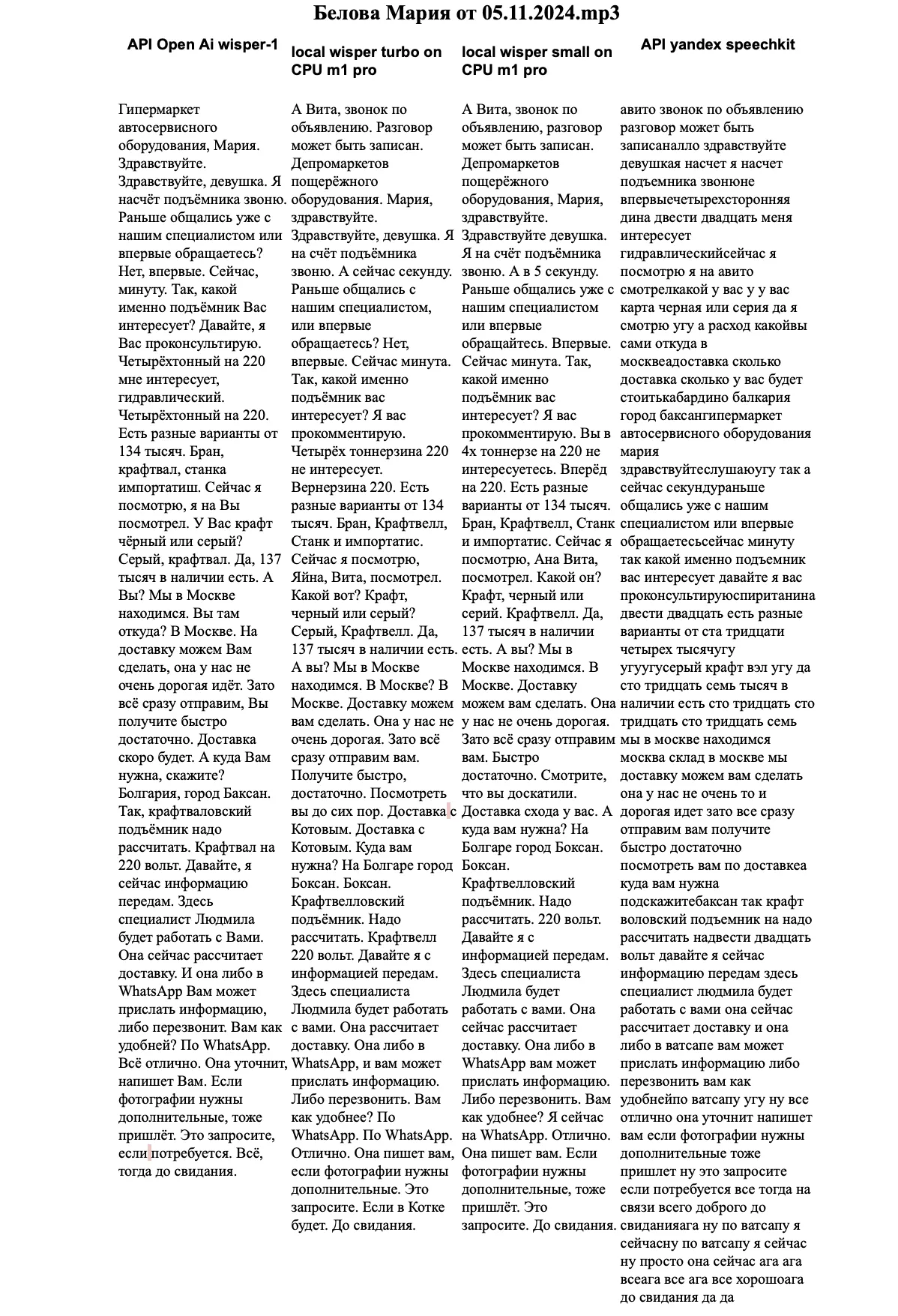

Таблице 2. Результат транскрбирования аудио файлов.

Связка (распознавание речи API Open Ai wisper-1 + разделения текста по собеседникам API gpt

Заключение:

В этой статье мы рассмотрели ключевые технологии для автоматической транскрибации речи, которые находят широкое применение в различных областях, от создания субтитров до анализа звонков в колл-центрах. Мы проанализировали современные мультиязычные модели, такие как Whisper от OpenAI и Yandex SpeechKit, а также детально рассмотрели их отличия с точки зрения производительности, точности, ресурсов, стоимости и масштабируемости.

Модели на основе архитектуры трансформеров, такие как Whisper, продемонстрировали высокую эффективность в распознавании речи, особенно при работе с большими объемами данных и мультиязычным контентом. Локальные модели, такие как Local Whisper Small и Whisper Turbo, показывают хорошие результаты при работе с ограниченными вычислительными ресурсами, позволяя использовать их на устройствах с процессорами Apple M1, что особенно полезно для пользователей, которым необходимы быстрые решения без зависимости от интернет-соединения.

С другой стороны, Yandex SpeechKit представляет собой удобное облачное решение с высоким качеством распознавания, особенно для русскоязычных проектов, и является привлекательным для небольших и средних проектов благодаря доступным ценовым моделям и удобной интеграции с другими сервисами Яндекса.

Выбор подходящей технологии зависит от множества факторов, включая требования к точности, объему данных, ресурсам устройства и бюджетам на инфраструктуру. Для крупных проектов с высокими требованиями к точности и масштабируемости лучше подойдет использование облачных решений, таких как Whisper-1 API от OpenAI или Yandex SpeechKit, в то время как для локальных приложений с ограниченными вычислительными ресурсами идеально подойдут Local Whisper Small или Whisper Turbo.

Таким образом, каждая из рассмотренных моделей имеет свои сильные стороны и ограничения, и их правильный выбор зависит от конкретных условий эксплуатации и целей проекта. В будущем, с развитием технологий и улучшением моделей распознавания речи, можно ожидать дальнейших улучшений как в точности, так и в производительности таких систем, что открывает новые горизонты для их применения.